구글 어시스턴트, 한국어도 “오케이, 구글”

http://www.bloter.net/archives/290622

구글은 9월21일 인공지능(AI) 기반의 음성비서 기술인 구글 어시스턴트의 한국어 서비스를 출시했다.

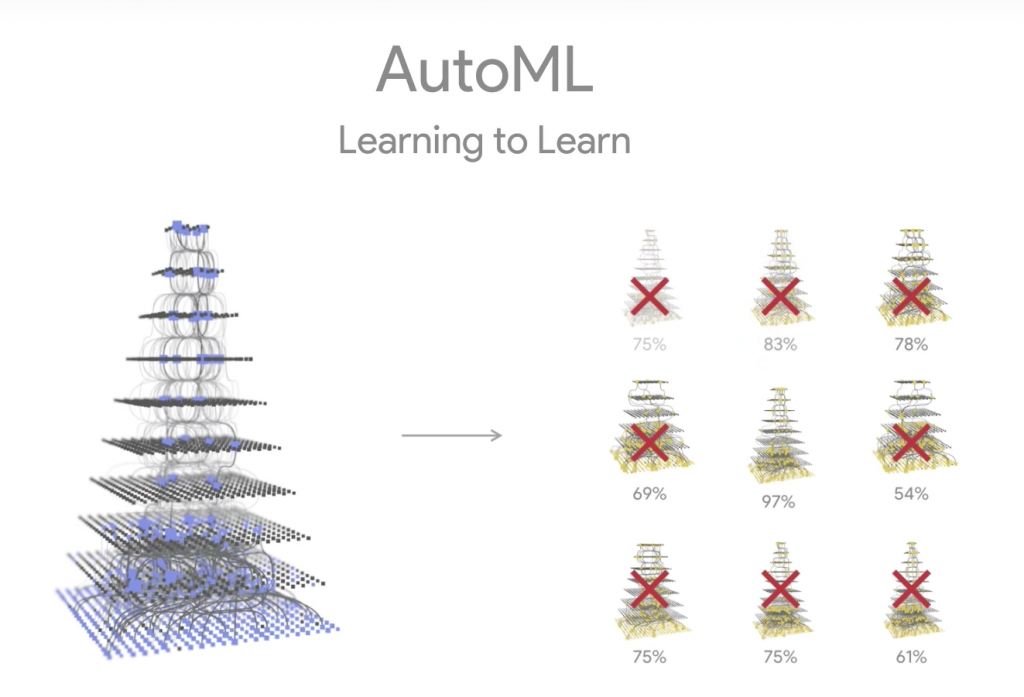

구글 어시스턴트는 머신러닝을 기반으로 한 자연어 처리, 음성인식, 번역 등과 같은 기술을 바탕으로 사용자의 질문에 대답하고 정보를 찾는 등 맞춤형 서비스를 제공한다. AI 스피커 등에서 쓰이다가 스마트폰에는 올해 3월 처음으로 탑재됐다.

구글 어시스턴트의 한국어 서비스는 LG전자가 최근 출시한 ‘V30’에서 우선 만나볼 수 있다. 몇 주 내로 안드로이드 6.0 이상(마시멜로, 누가, 오레오)을 사용하는 LG폰 외 여타 안드로이드 스마트폰에서도 구글 어시스턴트를 이용할 수 있다.

구글 어시스턴트를 부르는 방법

구글 어시스턴트 한국어 서비스를 지원하는 스마트폰 기기에서 권한 설정 및 사용자 음성 인식 훈련을 통해 사용 설정을 한다. 이후 홈 버튼을 길게 누르거나 ‘오케이 구글’이라고 부르면 활성화된다.

- 일정 관리

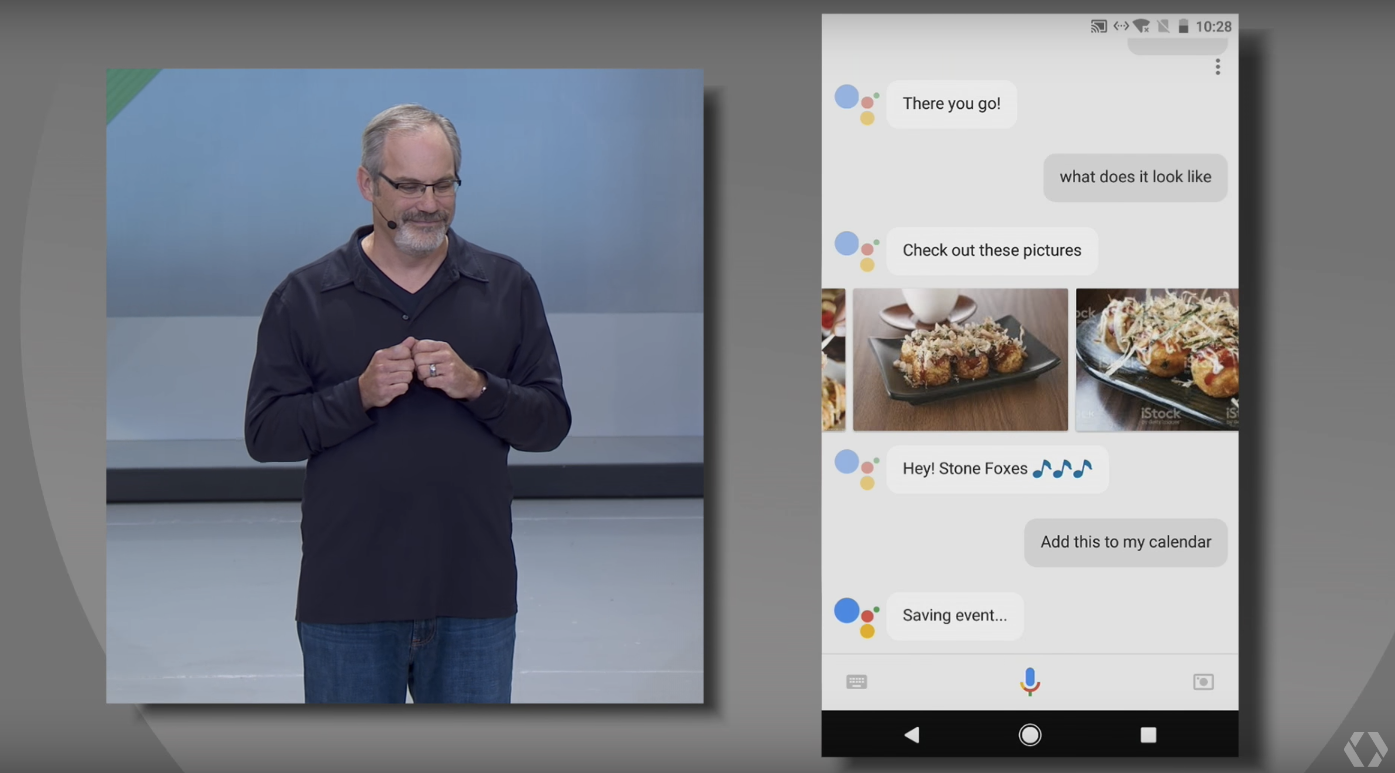

구글 어시스턴트는 캘린더, 지메일, 검색, 사진, 지도 등 구글의 다양한 앱과 연결된다. “오늘 내 스케줄 알려줘”라고 말하면 날씨를 알려주고 출근 시간이 얼마나 걸릴지, 첫 미팅이 몇 시에 시작하는지 등 하루 일과에 필요한 정보를 요약해 알려준다.

- 오늘 내 스케줄 알려 줘

- 나의 하루는 어때?

- 내일 아침 7시에 알람 맞춰줘

- 계란찜 타이머 설정해줘

- 실시간 답변

날씨, 좋아하는 스포츠 팀의 경기 결과, 현재 주가에 대한 최근 소식 등 구글 어시스턴트는 인물, 장소 및 사물에 대한 유용한 정보를 제공한다.

- 내일 서울 날씨 어때?

- 구글 주가는 얼마야?

- 265 곱하기 72는?

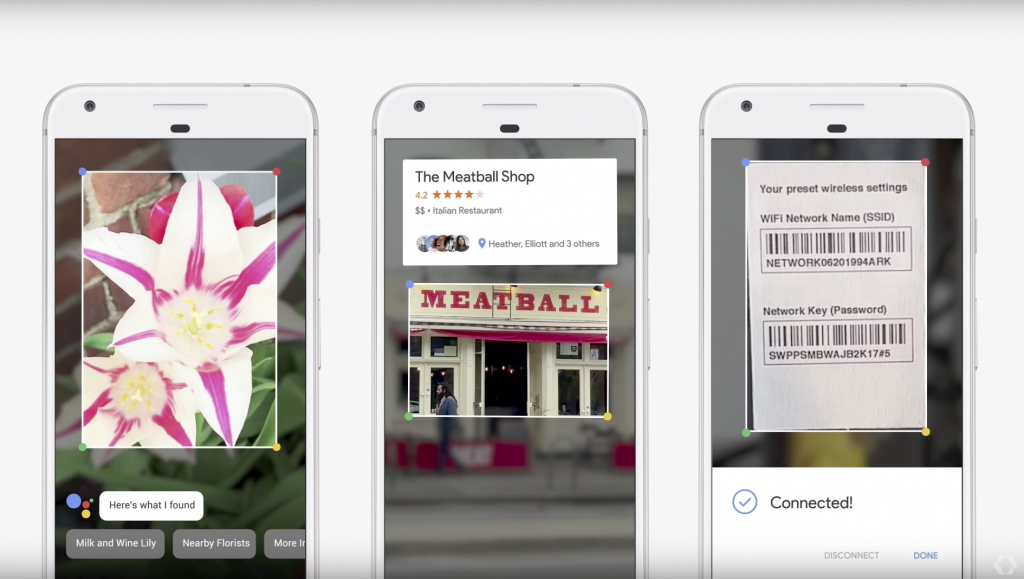

- 여행 어시스턴트 사용

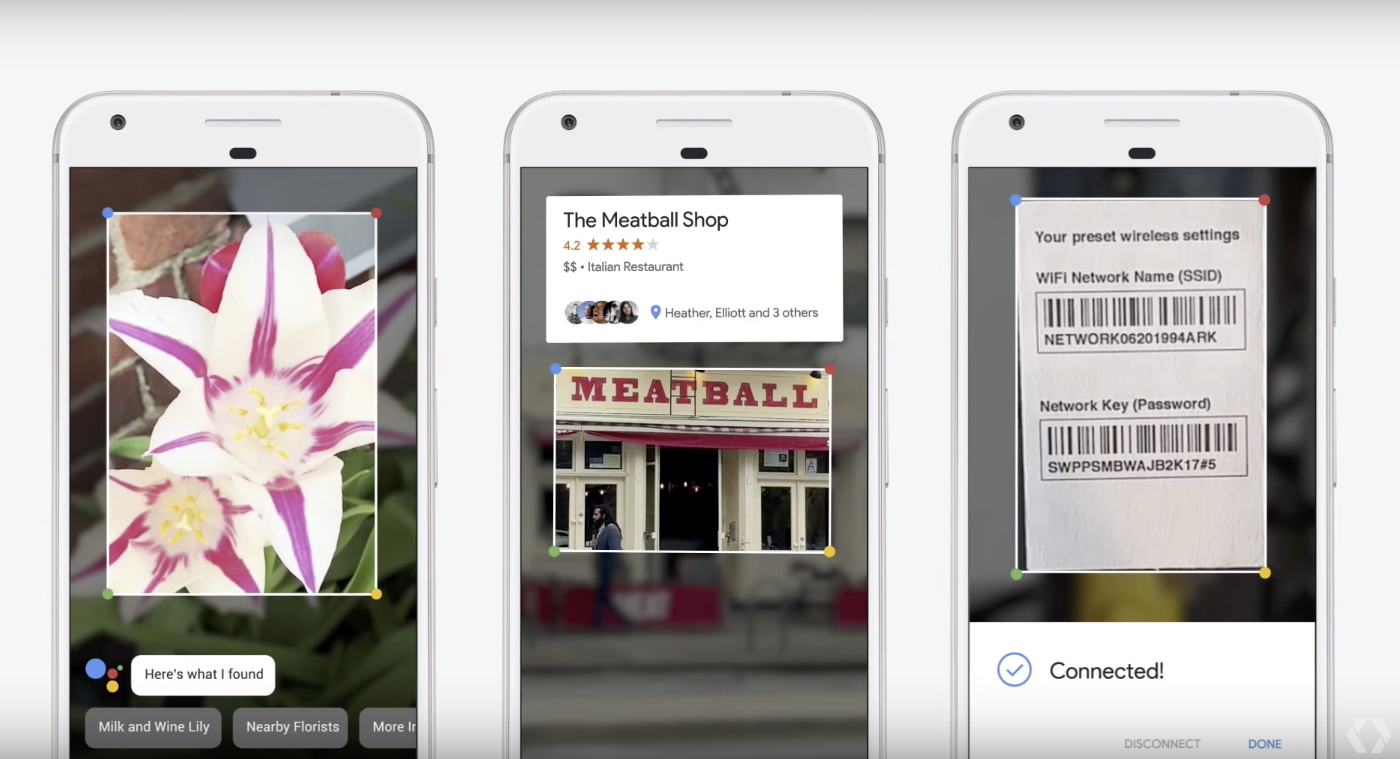

해외 여행할 때 구글 지도와 구글 번역은 필수다. 이제 구글 어시스턴트가 한국어를 지원하니 다음 여행에서는 구글 어시스턴트를 불러 도움을 받아보자. 빠른 번역, 호텔에서 해변으로의 가장 빠른 경로, 환율 등을 알려준다. 또한 현지 식당, 카페, 노래방 등까지 추천해준다. 근처의 장소를 구글 어시스턴트에게 물으면 구글이 알아서 몇 가지 선택지를 제공한다.

- 1달러는 얼마야?

- ‘얼마에요’를 스페인어로 번역해 줘

- 강남역 근처 일식집 알려 줘

- 사진 감상 및 비디오 시청

구글 어시스턴트에게 “사진 찍어줘” 혹은 “셀카 찍어줘”라고 말하면 카메라 앱이 실행된다. 찍으려고 굳이 홈 버튼을 누를 시간에 카메라 앱을 켜는 게 빠를 수도 있다. 하지만 사진을 보는 건 확실히 편리하다. 구글 어시스턴트에 “최근에 찍은 내 사진 보여줘”라고 말하면 구글 포토에서 사진을 찾아와서 대화에 불러올 수 있다. 동영상에도 적용되는 기능이다. 좋아하는 뮤직비디오를 보고 싶을 때에도 “유튜브에서 음악 재생해줘”라고 말하면 구글 어시스턴트가 유튜브 앱을 실행한다.

- 셀카 찍어줘

- 최근에 찍은 내 사진 보여줘

- 유튜브에서 음악 재생해줘

- 친구 및 가족과 연락하기

전화, 문자, 이메일 전송도 쉽게 할 수 있다. 아이폰의 ‘시리’, 삼성의 ‘빅스비’가 하는 기능과 비슷하다. 손으로 굳이 타이핑을 치지 않아도 될 일은 구글 어시스턴트에게 맡기자.

- 엄마한테 “5분 뒤에 도착”이라고 문자 보내줘

- 아빠한테 전화 해줘

- 이메일 보내줘

- 휴대전화 최적화

매번 와이파이, 블루투스를 키고 끄기 위해 스마트폰을 열고 설정을 누르는 게 귀찮았다면 이제 그것도 구글 어시스턴트에게 시키자. 기본적인 설정 조작을 구글 어시스턴트에게 시킬 수 있다. 손전등도 구글 어시스턴트가 켜준다. 또한 비행기 이륙 직전 구글 어시스턴트에게 비행기 모드 활성화를 요청할 수도 있다.

- 비행기 모드 켜 줘

- 블루투스 활성화 해 줘

- 와이파이 켜줘

- 재미있는 기능

구글 어시스턴트를 사용해 게임을 즐길 수 있다. 동전을 던져서 누가 다음 차례인지 정하거나, 심심할 때 재미있는 사실을 알아볼 수 있다.

- 나 심심해

- 비트박스 해줘

- 노래 불러 봐

- 재밌는 얘기 해줘

- 동전 던지기

- 사자는 어떻게 울어?

이외에도 구글 어시스턴트는 다양한 기능을 제공한다. 장규혁 구글 테크니컬 프로그램 매니저는 “점점 더 많은 사람들이 구글에서 필요한 정보를 찾을 뿐만 아니라 일상생활에서 도움을 받기를 원한다”면서 “앞으로 더 다양한 기기에 구글 어시스턴트 한국어 서비스를 확대할 수 있기를 희망한다”고 말했다.

한편 이번 업데이트를 통해 구글 어시스턴트는 ▲한국어 ▲영어 ▲프랑스어 ▲독일어 ▲스페인어 ▲브라질-포르투갈어 ▲힌디어 ▲인도네시아어 ▲일본어 등 총 9개의 언어를 지원하게 됐다.

구글 어시스턴트 한국어 서비스는 1.5GB 이상 RAM과 720P 이상 해상도를 지원하는 안드로이드 6.0 이상 버전 스마트폰에 자동으로 적용될 예정이다. 안드로이드 6.0 이전 버전이라면 구글 어시스턴트는 아쉽게도 사용할 수 없다. 사용자는 별도의 업데이트 없이 구글 어시스턴트를 사용할 수 있다.

...

'프로그래밍 > AI_DeepLearning' 카테고리의 다른 글

| [ML] 개발자가 알려주는 ‘AI 연구가 괴로운 순간’ 7가지 (0) | 2017.10.19 |

|---|---|

| [AI] 인공지능과 사랑에 빠질 수 있을까? (0) | 2017.09.26 |

| from mobile first to Voice First (0) | 2017.09.19 |

| [AI] ‘카카오미니’, 9월18일 예판…멜론 1년권 포함 5만9천원 (0) | 2017.09.12 |

| [AI] 인공지능비서, 거실→아파트→자동차로 영토 넓힌다 (0) | 2017.09.12 |