google.colab 가져오기 파일에서 Jupyterlab에서 파일의 동일한 동작을 얻는 방법

현재 colab에서 잘 돌아가는 프로젝트를 진행하고 있는데 로컬 jupyterlab에서 수정하고 실행하고 싶지만 해당 프로젝트에는 colab과 같은 특정 기능이 있고 이런 방식으로 가져온 files기능 이 output있습니다 .from google.colab import filesfrom google.colab import output

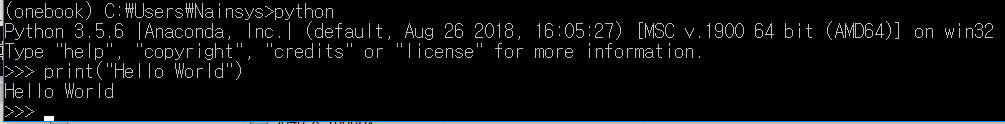

pypi에서 찾았으니 기본적 으로 모듈을 로컬에 설치한 pip install google-colab다음 노트북에서 사용할 수 있습니다.

'프로그래밍 > Python' 카테고리의 다른 글

| [python] 파이썬 모듈 예제 (0) | 2023.03.21 |

|---|---|

| 파이썬 제어문 python control-flow (0) | 2023.03.17 |

| [python] Text2Art - https://text2art.com/ (0) | 2023.03.14 |

| [python] What will be the output? (0) | 2023.03.10 |

| conda에서 파이썬 가상 환경 (virtual environments) 생성하기 (0) | 2023.03.08 |